Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Hugging Face

Користувач Hugging Face поділився

ToonComposer: Тепер ви можете ефективно створювати мультфільми на @huggingface безкоштовно

- Вхідні дані: ключові кадри на основі ескізів + кольорова рамка відліку

- Ця модель, заснована на @Alibaba_Wan, буде поєднувати в собі міжряддя і розфарбовування

- Модель також може уявити області, залишені порожніми, за допомогою підказки

- Результат: економія до 70% ручної роботи.

Величезне спасибі B&T Studio та Gudong Animation Studio за дозвіл використовувати їхній анімаційний контент (Big Fish & Begonia та Mr. Miao) для академічної ілюстрації.

37,74K

Користувач Hugging Face поділився

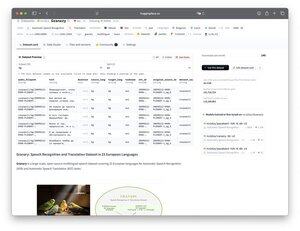

NVIDIA НА ХОДУ! Моделі Canary 1B і Parakeet TDT (0.6B) SoTA ASR - багатомовні, з відкритим вихідним кодом 🔥

- Параметри 1В і 600М

- 25 мов

- автоматичне визначення мови та переклад

- позначки часу слів і речень

- Транскрибуйте до 3 годин аудіо за один раз

- навчено на 1 мільйоні годин даних

- SoTA в таблиці лідерів Open ASR

- Ліцензія 💥 CC-BY

Доступно на Hugging Face, перевірте їх сьогодні!

120,9K

Користувач Hugging Face поділився

Hugging Face просто скинули аркуші зі штучним інтелектом для створення та збагачення наборів даних, не написавши жодного рядка коду.

Працює з Qwen, Kimi, Llama 3 та іншими LLM з відкритим вихідним кодом.

100% безкоштовний, локальний та з відкритим вихідним кодом.

51,18K

Користувач Hugging Face поділився

Ми випустили нашу модель TTS на базі LFM2-350M з відкритим вихідним кодом 🚀 Ми також випустили багато різних моделей FT.

Платформа графічного процесора: @hyperbolic_labs

Дані: Емілія + Емілія Йодас (EN)

Модель LLM: LFM2-350M @LiquidAI_

Диск і місце: @huggingface

Я дуже радий, що випустив цю модель з відкритим вихідним кодом. Величезне спасибі @VyvoSmartChain

#opensource #speech #tts #huggingface #lfm #gpu

35,06K

Користувач Hugging Face поділився

🚨 Велика новина! Ми вирішили, що бібліотека @huggingface після навчання, TRL, підтримуватиме навчання моделей мови 🖼️ бачення

Це ґрунтується на нашій нещодавній підтримці VLM у SFTTrainer — і ми не зупинимося, поки TRL не стане навчальною бібліотекою 🥇 #1 VLM

Більше тут 👉

Величезне спасибі @mervenoyann , @SergioPaniego і @ariG23498 🔥

28,54K

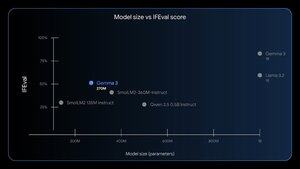

270 мільйонів (не мільярд) параметрів! ⚡️⚡️⚡️

Omar Sanseviero15 серп., 00:04

Знайомство з Gemma 3 270M 🔥

🤏Крихітна модель! Всього 270 мільйонів параметрів

🧠 Дуже сильне дотримання інструкцій

🤖 Тонке налаштування всього за кілька хвилин, з великим словниковим запасом, щоб служити високоякісною основою

38,22K

Найкращі

Рейтинг

Вибране

Актуальне ончейн

Популярні в X

Нещодавнє найкраще фінансування

Найбільш варте уваги