热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

你不能像其他产品那样构建AI产品。

AI产品本质上是非确定性的,你需要不断地在自主性和控制之间进行权衡。

当团队没有意识到这些差异时,他们的产品会面临意想不到的失败,他们被困在调试大型复杂系统中,无法追踪,而用户对产品的信任也在悄然流失。

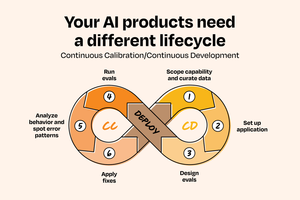

在看到这一模式在包括@OpenAI、@Google、@Amazon和@Databricks在内的50多个AI实施中反复出现后,Aishwarya Naresh Reganti和Kiriti Badam开发了一个解决方案:持续校准/持续开发(CC/CD)框架。

这个名字是对持续集成/持续部署(CI/CD)的引用,但与其名字所指的不同,它是为行为非确定性且需要获得自主性的系统而设计的。

这个框架向你展示如何:

- 从高控制、低自主性的特性开始

- 构建真正有效的评估系统

- 在不破坏用户信任的情况下扩展AI产品

它旨在识别AI系统的独特性,帮助你构建更有意图、更稳定和更值得信赖的AI产品。

他们首次公开分享这一内容:

99.58K

热门

排行

收藏