熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

你不能像其他產品那樣構建AI產品。

AI產品本質上是非確定性的,你需要不斷地在自主性和控制之間進行權衡。

當團隊沒有意識到這些差異時,他們的產品會面臨意想不到的失敗,他們被困在調試大型複雜系統中,無法追蹤,而用戶對產品的信任也在悄然流失。

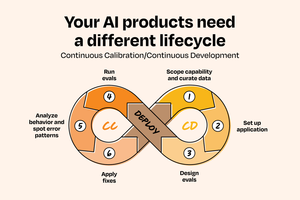

在看到這一模式在包括@OpenAI、@Google、@Amazon和@Databricks在內的50多個AI實施中反覆出現後,Aishwarya Naresh Reganti和Kiriti Badam開發了一個解決方案:持續校準/持續開發(CC/CD)框架。

這個名字是對持續集成/持續部署(CI/CD)的引用,但與其名字所指的不同,它是為行為非確定性且需要獲得自主性的系統而設計的。

這個框架向你展示如何:

- 從高控制、低自主性的特性開始

- 構建真正有效的評估系統

- 在不破壞用戶信任的情況下擴展AI產品

它旨在識別AI系統的獨特性,幫助你構建更有意圖、更穩定和更值得信賴的AI產品。

他們首次公開分享這一內容:

99.58K

熱門

排行

收藏